Disclaimer: ogni riferimento a fatti e persone dell’attualità è puramente casuale.

Inizio questo articolo mettendo le mani avanti, perché il film di cui parliamo oggi affronta un argomento – il rischio di una guerra atomica fra Usa e Urss in piena guerra fredda – che fa eco alle notizie di questi giorni. Non parlerò di quello, non è il punto focale su cui voglio concentrarmi.

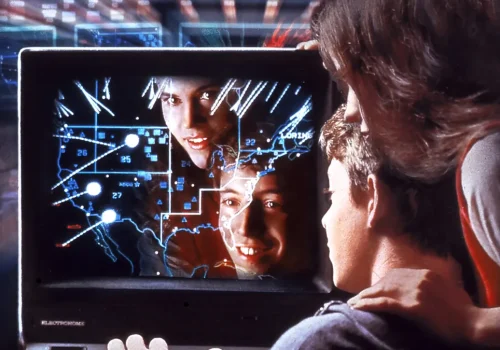

>>> CineNerd “War Games” (1983, John Badham) <<<

WarGames è un film veramente celeberrimo, sono convinta che buona parte di voi l’abbia visto, almeno un qualche spezzone.

Film del 1983, racconta di come la risibile sicurezza informatica del NORAD (cioè il North American Aerospace Defense Command, cioè il Comando di Difesa Aerospaziale del nord-America), una delle installazioni militari più sicure al mondo, porti sull’orlo di una guerra termonucleare globale tra USA e URSS, in piena guerra fredda. Immaginate: un ragazzino che per avere in anteprima un videogioco “hackera” quello che crede essere il server di un’azienda informatica e in pochi minuti finisce dentro ad un supercomputer che può lanciare missili nucleari (veri). Siamo sinceri, il film è tragicomico e oggettivamente è invecchiato male, ma le due tematiche evergreen che propone (molto in anticipo sulla vita reale di tutti noi) sono:

– la sicurezza dei sistemi alle intrusioni esterne;

– l’opportunità o meno di bypassare l’intervento umano nel processo decisionale.

Quando si parla di AI, non si parla mai abbastanza di AI

Quanto al primo punto, ne ho già parlato qui (CineNerd: Hackers), quindi passerei al secondo punto, secondo me più interessante e che tutto sommato passa sottotraccia per buona parte del film.

Se “il libero arbitrio delle AI” è tema già affrontato nella scorsa puntata, qui vorrei soffermarmi su una questione parallela, cioè l’opportunità o meno di permettere alle AI di prendere decisioni.

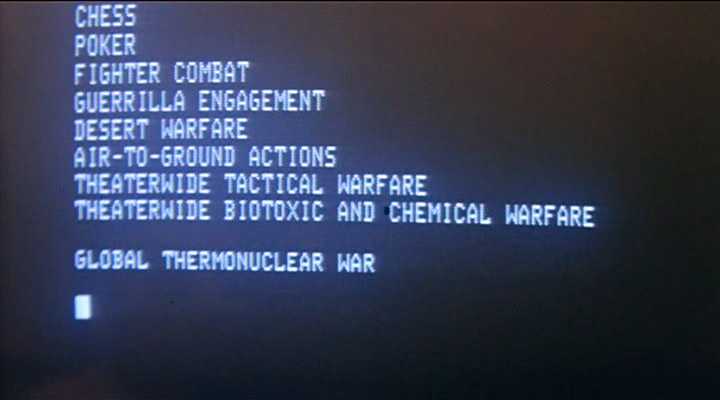

Il film si schiera di fronte ad un nettissimo no: decidere di lasciare solo ad un supercomputer la responsabilità di agire in autonomia non è saggio. Le AI non hanno empatia, non hanno compassione, non hanno umanità. “Joshua” è stato programmato per imparare a vincere la guerra con le strategie migliori giocando a vari giochi (tra cui gli scacchi) e viene “sconfitto” facendogli imparare che nel Tic Tac Toe (il gioco del tris) non è possibile vincere, quindi la strategia migliore è non giocare. Happy ending. Le tecnologia è andata avanti, le AI sono diventate ben più raffinate di Joshua, ma la questione resta: è il caso di soppiantare operatori umani su operazioni sensibili con AI?

Ora come allora, per me la risposta è no.

Decisioni a basso impatto: snellire il lavoro si può

Esistono decisioni a basso impatto, il cui processo è lineare e possono essere demandate ad un computer.

Faccio un esempio: l’AI dell’ufficio rileva dal gestionale che sono rimaste solo 3 risme di carta e sulla base dei riordini precedenti, dei volumi di utilizzo e del costo budgettizzato per la cancelleria, invia da sola l’ordine al fornitore per 100 pezzi. Pulito, funzionale. Nessuno resta senza carta o si dimentica di ordinarla perché è una questione secondaria.

Esistono però decisioni decisamente più complesse, come ad esempio stabilire i budget, che devono passare dal nulla osta di una persona vera (anche se l’AI può comunque fornire dei suggerimenti non vincolanti). Esistono qualità squisitamente umane come l’empatia che inducono a prendere decisioni che un’AI magari riterrebbe illogiche, ma che seguono regole che vanno ben oltre la capacità di calcolo di un computer e sono le decisioni ad altissimo valore aggiunto che permettono alle Aziende di far volare gli affari.

Un’AI può aiutarvi a lavorare meglio, su questo non abbiamo dubbi.

Come sul fatto che siete insostituibili.

Non da un computer, almeno!

Alla prossima puntata!

Elena Iseni

Resp. Mkt e Comunicazione